처음 나온 인공지능은 통계기반의 의사결정을 내리는 인공지능 인공지능은 통계 알고리즘을 통해 스스로 개선해서 데이터가 프로그래밍을 수행하도록 지원 머신러닝이 아닌 인공지능은 규칙기반 학습과 추론라고 도 하며 여러번 데이터를 통해 규칙을 도출하여 새로운 데이터에 대해서도 자동화/최적화를 위하여 사용한다. 즉 귀찮아서..

매번 규칙기반 학습을 하기 힘드니깐 머신러닝이 나온 것이다. Neural Network를 통해 깊이 있게 쌓은 모델을 쌓은 기술 블랙박스 모델

지도학습은 레이블된 데이터가 있고, 명확한 목표를 가지며, 예측값과 실제 레이블을 비교하여 (아웃풋과 라벨 사이)평가할 수 있다.

비지도학습은 입력 데이터에 대한 레이블이 없는 상태에서 모델을 학습하는 방법으로, 목표는 데이터의 패턴이나 구조를 발견하는 것이고, 평가가 어렵다.

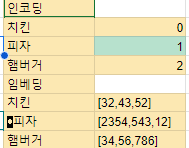

인코딩은 번호로 표현하는 것 임베딩하는 것은 좌표에 벡터로 표현하는 것,

cloze학습: 원문에 빈칸을 뚫고, 모델에 넣음

정형데이터 :테이블 데이터

MLM

Masked Languaged Model 의 약자로 colze task로 학습 시킨 모델들을 가리키는 말로 알고 있습니다. 예로는 BERT

confusion matrix

TP(True Positive), FN(False Negative), False Positive(FP), True Negative(TN)

Accuracy = TP+TN/ (TP+FN+FP+TN)

틀리지 않으면 높아짐

Precision = TP/(TP+FP) 모델이 예측한 것 중 (실제로) 맞는 것의 비율

스팸이라고 예측했는데, 실제로 스팸메일인 경우

Recall = TP/(TP+FN) (실제) 맞는 것 중에( 모델이) 맞았다고 예측한 비율

스팸 메일이라고 한 것 중에, 스펨메일인 경우

과대 적합

모델이 과하게 훈련집단에 학습되어 훈련 집합에 정확히 일치하게 되는 현상

해결방안:

정규화 기법을 사용하여 모델의 복잡도 감소

앙상블 기법: Bagging과 Boosting

프루닝(Pruning):결정트리에서 가지치기

더 많은 데이터 수집 혹은 데이터 증강

과소적합

모델이 훈련 집합에 대해서 충분히 학습되지 않아, 훈련 집합을 잘 맞추지 못하는 현상